我们需要NPU吗? 一文了解NPU神经处理单元的概念与需求

124人参与 • 2025-07-30 • 硬盘

生成式 ai 正在席卷全球。从智能手机到电脑,乃至未来的各种数字设备,ai 几乎无处不在。ai 的广泛应用需要强大的算力,而传统的 cpu 和 gpu 已经越来越难以胜任。于是,npu(神经处理单元)应运而生。

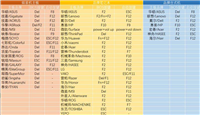

现在,像三星 galaxy s22、s23 和 s24 等旗舰智能手机已经开始搭载 npu。不过,npu 要在个人电脑中普及还需要一些时间。intel 和 amd 等芯片巨头已经开始推出集成 npu 的处理器,如 intel 的 meteor lake、core 和 core ultra 系列,以及 amd 的 ryzen 8040 系列等。

那么,npu 到底是什么?我们真的需要 npu 吗?本文将为你详细解读 npu 技术,帮助你了解它的定义和用途等。

npu 是什么?

npu 神经处理单元

简单来说,npu 是一种专门用于处理机器学习算法的处理器。它能够比传统 cpu 和 gpu 更快地执行复杂的数学运算,这对于高效运行神经网络至关重要。

npu 主要用于处理涉及大量小规模并行计算的 ai 任务。它在处理图片、视频等多媒体数据和神经网络数据时表现出色,因为这些处理器天生就是为了并行计算而设计的。

虽然 cpu 和 gpu 也能处理机器学习任务,但效率远不如 npu。此外,在设备中集成 npu 可以大大减轻 cpu 和 gpu 的负担,让它们能够更专注地执行其他任务。

npu 在功能和外观上与特定应用集成电路(asic)类似,但两者并不相同。npu 设计更为复杂和多功能,可以满足各种神经网络计算需求;而 asic 通常只针对单一用途(如加密货币挖矿)。npu 的强大能力来自于专门为神经网络计算而设计的硬件、软件、编程和驱动。

值得一提的是,google 也推出了自家的 ai 处理器,称为 tpu(张量处理单元)。虽然 tpu 的架构与 npu 不同,但同样专注于处理复杂的 ai 算法。

npu、cpu 和 gpu 有什么不同?

在 ai 计算中,需要执行大量的「乘加运算」(multiply accumulate, mac)。大多数 ai 算法都是由许多这样的运算构成,它们在大数据集上往往形成树状结构,更适合分批处理较小的计算任务。这正是 npu 的强项。

- cpu 则是执行多种任务的系统核心。

- gpu 则主要用于并行处理大型数据集,如图像和视频处理。

- 相比之下,npu 设计之初就是为了快速完成较小的计算任务。专门用于加速深度学习算法,因此在处理 ai 相关任务时,性能远超 cpu 和 gpu。

虽然 gpu 和 cpu 也能执行 ai 计算,但 npu 能将这些计算分解成更小的部分,从而实现更快速的处理。

推荐阅读:npu 与 gpu 有什么区别?

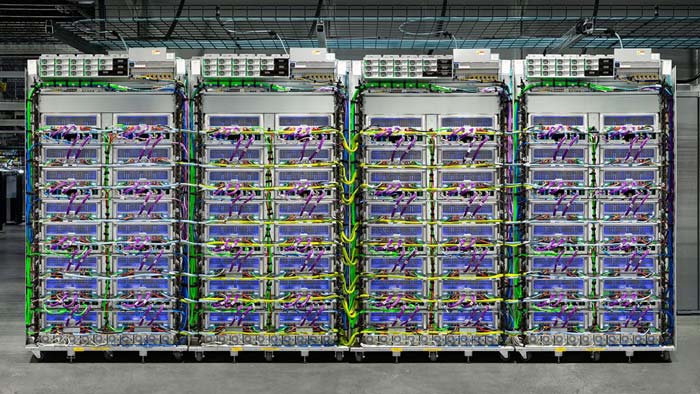

npu 与 tpu

google cloud tpu

google 开发的 tpu 同样专注于处理神经网络,与 npu 功能相似。但它们在架构上有显著的不同。

与采用传统冯·诺依曼架构(将内存和处理单元分离)的 npu 不同,tpu 采用了一种名为脉动阵列(systolic array)的特殊设计,将运算处理和内存单元合并在一个芯片上。因此,tpu 在进行并行计算时,能比 npu 更快、更高效。

目前,tpu 只在 google 的 pixel 手机和 google cloud 云平台上提供,随着版本迭代,每一代的性能都会有所提升。

虽然 npu 在峰值性能上要优于 tpu,但它们的能耗和延迟也更高;相比之下,tpu 的峰值性能稍低,但能耗更低,延迟也较小。

什么是 gpnpu?

gpnpu 并不是 gpu + npu 的结合体,而是代表「通用神经处理单元」(general purpose neural processing units)。

gpnpu 采用了统一处理器架构的单一执行管道,能够处理向量和矩阵运算,以及标量(控制)代码。由于整个设计只有一个由软件控制的核心,因此可以更轻松地处理复杂的并行工作负载。

npu 是未来趋势吗?

ai 正在逐渐成为主流技术。就以 windows 11 为例,几乎每个月都会推出新的 ai 功能。最近,微软在「照片」应用中添加了「生成式擦除」这一 ai 功能。此前,还推出了包括 copilot 在内的多项 ai 功能。此外,越来越多的应用和服务也开始整合 ai 技术。因此可以预见,ai 将很快渗透到我们生活的方方面面。

对于深度 ai 用户来说,npu 是一种非常有价值的硬件投资。如前所述,npu 能显著提升设备的处理能力。基于现有趋势,npu 将被广泛应用于日常使用的现代设备当中,未来甚至可能成为物联网(iot)设备的标配。

我需要 npu 吗?

目前市场上的大多数 ai 服务,如 openai 的 chatgpt 语言模型,都在云端进行计算。那为什么还需要本地 npu 呢?

- 使用本地 npu 的一个主要优势是可以显著减少数据在 intelnet 和本地之间返回的延迟。因此,如果你的工作高度依赖 ai,那么拥有专属的 npu 将大大提高处理速度。

- 此外,npu 还可以减轻 cpu 和 gpu 的负担,让它们可以空出资源来处理其他重要任务。如果你的系统搭载了 npu,你就能将 cpu 和 gpu 留给其他需要大量硬件资源的任务。

- 最后,如果你是 windows 11 用户,很多 24h2 及更高版本中的 ai 功能都需要满足 ai pc 或 copilot+ pc 条件的设备才能使用,例如 windows recall 和 windows studio effects 等。

综上所述,如果你频繁进行以 ai 为核心的计算任务,那么拥有 npu 将非常有价值。

您想发表意见!!点此发布评论

发表评论