如何在SpringCloud中使用Kafka Streams实现实时数据处理

34人参与 • 2024-07-28 • Java

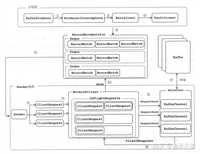

使用kafka streams在spring cloud中实现实时数据处理可以帮助我们构建可扩展、高性能的实时数据处理应用。kafka streams是一个基于kafka的流处理库,它可以用来处理流式数据,进行流式计算和转换操作。

下面将介绍如何在spring cloud中使用kafka streams实现实时数据处理。

1. 环境准备

在开始之前,我们需要确保已经安装了以下组件:

- jdk 8或更高版本

- apache kafka

- spring boot

- maven

2. 创建spring boot项目

首先,我们需要创建一个spring boot项目。你可以使用spring initializr来快速创建一个空项目,添加所需的依赖项。

<dependencies>

<!-- spring boot -->

<dependency>

<groupid>org.springframework.boot</groupid>

<artifactid>spring-boot-starter</artifactid>

</dependency>

<!-- spring kafka -->

<dependency>

<groupid>org.springframework.boot</groupid>

<artifactid>spring-boot-starter-kafka</artifactid>

</dependency>

<!-- kafka streams -->

<dependency>

<groupid>org.apache.kafka</groupid>

<artifactid>kafka-streams</artifactid>

</dependency>

</dependencies>

3. 配置kafka连接

在application.properties文件中添加kafka相关的配置:

spring.kafka.bootstrap-servers=localhost:9092

spring.kafka.consumer.auto-offset-reset=earliest

spring.kafka.consumer.group-id=my-group

4. 创建kafka streams处理器

我们需要创建一个kafka streams处理器来定义我们的数据处理逻辑。可以创建一个新的类,实现spring的kafkastreamsdsl接口:

@configuration

@enablekafkastreams

public class kafkastreamsprocessor implements kafkastreamsdsl {

private static final string input_topic = "my-input-topic";

private static final string output_topic = "my-output-topic";

@override

public void buildstreams(streamsbuilder builder) {

kstream<string, string> inputtopic = builder.stream(input_topic);

// 在这里添加数据处理逻辑

kstream<string, string> outputtopic = inputtopic

.mapvalues(value -> value.touppercase())

.filter((key, value) -> value.length() > 5);

outputtopic.to(output_topic);

}

}

在上面的代码中,我们创建了一个输入主题my-input-topic和一个输出主题my-output-topic。然后,我们使用mapvalues方法将输入流中的值转换为大写,并使用filter方法过滤长度大于5的记录。最后,我们使用to方法将输出流写入输出主题。

5. 启动kafka streams处理器

我们可以在spring boot应用程序的主类中启动kafka streams处理器:

@springbootapplication

public class application {

public static void main(string[] args) {

springapplication.run(application.class, args);

kafkastreamsprocessor kafkastreamsprocessor =

new kafkastreamsprocessor();

kafkastreamsprocessor.start();

}

}

在上面的代码中,我们创建了一个kafkastreamsprocessor实例,并调用start方法来启动kafka streams处理器。

6. 生产和消费消息

现在,我们可以使用kafka生产者向输入主题发送消息,并使用kafka消费者从输出主题接收处理后的数据。

@restcontroller

public class messagecontroller {

@autowired

private kafkatemplate<string, string> kafkatemplate;

@postmapping("/send")

public responseentity<string> sendmessage(@requestbody string message) {

kafkatemplate.send("my-input-topic", message);

return responseentity.ok("message sent successfully");

}

@getmapping("/receive")

public responseentity<list<string>> receivemessages() {

list<string> messages = // 从输出主题读取消息

return responseentity.ok(messages);

}

}

在上面的代码中,我们使用kafkatemplate来发送消息到输入主题。在/receive接口中,我们从输出主题读取数据并返回给客户端。

7. 运行应用程序

现在,我们可以运行应用程序并进行测试。可以使用以下命令启动应用程序:

mvn spring-boot:run

然后使用postman或其他http客户端发送post请求到/send接口,并使用get请求从/receive接口接收处理后的数据。

8. 高级配置和扩展

在spring cloud中使用kafka streams还可以进行更高级的配置和扩展。以下是一些示例:

- 支持多个输入和输出主题

- 使用ktable进行状态管理

- 使用serde自定义序列化和反序列化

- 使用

join和window操作进行流-流和流-表操作 - 使用

globalktable和globalstore进行全局状态管理

这些功能可以进一步提高kafka streams在spring cloud中的灵活性和可扩展性。

总结

本文介绍了如何在spring cloud中使用kafka streams实现实时数据处理。通过配置和编写kafka streams处理器,我们可以在spring boot应用程序中使用kafka streams库来进行实时数据处理。希望本文对你有所帮助,谢谢阅读!

您想发表意见!!点此发布评论

发表评论